Sztuczna inteligencja na podstawie naszego chodu odgadnie, czy czujemy złość, radość czy smutek17.07.2019

Mieliśmy już do czynienia z programami, które odczytują emocje z ludzkiej twarzy albo głosu. Teraz sztuczna inteligencja rozpozna je poprzez analizę samego sposobu chodzenia.

Nasze emocje potrafią zdefiniować nie tylko nasze myślenie, apetyt czy sen, ale to, jakim krokiem poruszamy się na ulicy. Naukowcy z Uniwersytetu Północnej Karoliny w Chapel Hill, a także z Uniwersytetu w Maryland postanowili stworzyć narzędzie, które na podstawie chodu określi kierujące człowiekiem emocje.

Badacze wykorzystali system uczenia maszynowego (ang. deep learning), w którym komputer nie wykonuje szeregu zaprogramowanych równań, a uczy się sam. Na podstawie zebranych danych tworzy reguły, sieci semantyczne, rozkłady prawdopodobieństwa albo drzewa decyzyjne. W ten sposób algorytm potrafi sam generować wnioski i analizować. Oczywiście zawsze istnieje próg błędu, bo według austriackiego filozofa, Karla Poppera „wiedza zdobyta w wyniku obserwacji ma charakter jedynie domyślny” (Conjectures and Refutations: The Growth of Scientific Knowledge 1963).

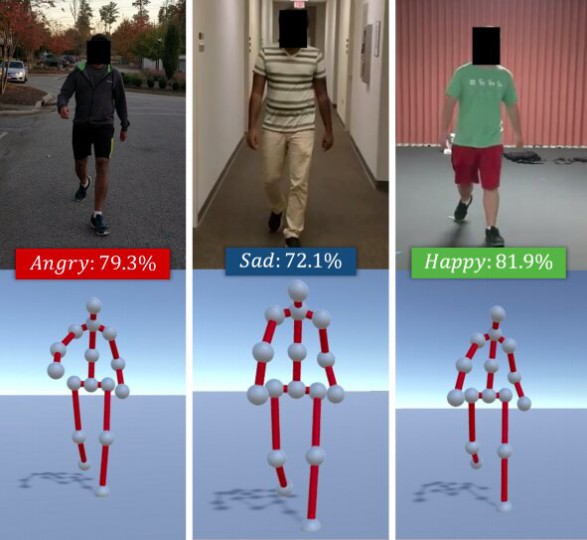

To właśnie na bazie deep learning badacze stworzyli oprogramowanie Emotion Walk (EWalk), które analizuje nagrania wideo z poruszającymi się w przestrzeni ludźmi. Sztuczna inteligencja wyciąga z ruchu dominujące elementy i przyporządkowuje je do konkretnych emocji. Analizuje informacje na bieżąco, w odniesieniu do tego, co już „widziała”.

Według opublikowanego niedawno badania, obecna metoda określa stan emocjonalny człowieka wobec jego chodu z dokładnością do 80 proc. Są to jednak proste, podstawowe emocje, jak radość, smutek, gniew albo neutralny stan.

Istnieją jednak głosy krytyki wobec oprogramowania. Zdaniem Aniketa Bery, profesora informatyki z Uniwersytetu Północnej Karoliny, który nadzorował badanie, same założenia są niewłaściwe. Sposób badania jest szacunkowy, funkcjonuje na zasadzie prognozy, bo nie ma dostępu do wszystkich niezbędnych danych dotyczących ludzkich emocji – koncentruje się jedynie na tym, co jest dostrzegalne na zewnątrz.

Mimo to stworzone narzędzie – jeśli będzie konsekwentnie rozwijane i ulepszane – może pomóc w lepszym programowaniu ruchów i zachowań robotów albo wirtualnej rzeczywistości.

zobacz także

- Przyznano Grammy 2022. Wśród zwycięzców Olivia Rodrigo, Silk Sonic i Jon Batiste

Newsy

Przyznano Grammy 2022. Wśród zwycięzców Olivia Rodrigo, Silk Sonic i Jon Batiste

- Jak potoczy się historia muskularnego pingwina? Gra, którą każdy może sam dokończyć

Newsy

Jak potoczy się historia muskularnego pingwina? Gra, którą każdy może sam dokończyć

- Ziggy Stardust jako lalka Barbie z okazji 50-lecia „Space Oddity”

Newsy

Ziggy Stardust jako lalka Barbie z okazji 50-lecia „Space Oddity”

- „The Night House”: Rebecca Hall kontra nawiedzony dom w nowym horrorze reżysera „Rytuału”

Newsy

„The Night House”: Rebecca Hall kontra nawiedzony dom w nowym horrorze reżysera „Rytuału”

zobacz playlisty

-

Andriej Tarkowski

02

02Andriej Tarkowski

-

Papaya Young Directors top 15

15

15Papaya Young Directors top 15

-

Music Stories PYD 2020

02

02Music Stories PYD 2020

-

Animacje krótkometrażowe ubiegające się o Oscara

28

28Animacje krótkometrażowe ubiegające się o Oscara